News

新しい自然言語のAIモデル(Sōseki)がEfficient QAコンペティションのトラックで準優勝

2020年12月6〜12日に開催された機械学習に関するトップ国際会議であるConference on Neural Information Processing Systems(NeurIPS)で開催されたEfficient Open-Domain Question Answering Competition において、弊社と東北大学の研究チームが開発した自然言語のAIモデルSōsekiが、 Systems under 6GBトラックでFacebook社に次いで準優勝、UnrestrictedトラックでMicrosoft社 ・Facebook社に次いで参加チーム中3位になりました。

参考: Efficient Open-Domain Question Answering

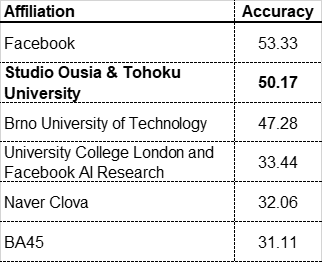

Systems under 6GB leaderboard

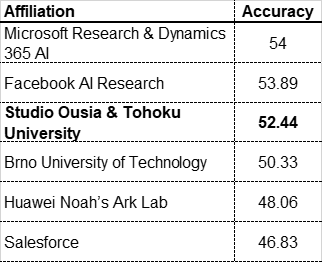

Unrestricted track leaderboard

このコンペティションは、Googleで実際に検索された1,800問の質問に対して解答を文字列で返して正解率を競うコンペティションです。Systems under 6GBトラックは、実用的なシステムを対象としたトラックで、モデルやデータを含むシステム全体のイメージサイズを6GB以内におさめる必要があります。また、システムはインターネットへのアクセスを禁止されるため、必要なデータは全て6GBのイメージ内に格納する必要があります。Unrestrictedトラックはそうした制約のないものになっています。

Sōsekiは検索を行うモデル(Retriever)と解答を抽出するモデル(Reader)の2つのニューラルネットワークのモデルで構成されており、質問に対して解答を含みそうなWikipediaのパッセージを検索し、そのパッセージから該当する解答を高精度に抜き出すシステムです。

今後、弊社ではSōsekiの技術をマニュアルや社内の文書等に適用し、新プロダクトとしてリリースする予定です。

NeurIPS 2020発表資料